Lei de Poisson

| Lei de Poisson | |

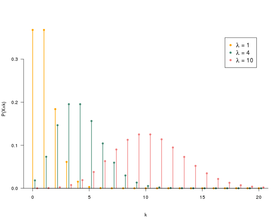

Função de massa As funções de massa são definidas apenas para inteiros k . | |

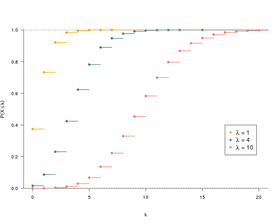

Função de distribuição | |

| Definições | |

|---|---|

| Apoiar | |

| Função de massa | |

| Função de distribuição |

(onde é a função gama incompleta ) e onde é a parte inteira padrão de x |

| Ter esperança | |

| Mediana | |

| Moda |

se for um real não inteiro,

e se é um inteiro |

| Variância | |

| Assimetria | |

| Curtose normalizada | |

| Entropia |

Para grande:

|

| Função geradora de momento | |

| Função característica | |

| Função geradora de probabilidade | |

Em teoria de probabilidade e estatística , a lei de Poisson é uma lei de probabilidade discreta que descreve o comportamento do número de eventos que ocorrem em um intervalo de tempo fixo, se esses eventos ocorrerem com uma frequência ou expectativa média conhecida, e independentemente do tempo decorrido desde o anterior evento.

A lei de Poisson também é relevante para descrever o número de eventos em outros tipos de intervalos, espaciais ao invés de temporais, como segmentos, áreas ou volumes.

História

A lei de Poisson foi introduzida em 1838 por Denis Poisson (1781-1840), em sua obra Recherches sur la probabilidade des julgamentos em questões civis e criminais . O tópico principal deste livro consiste em certas variáveis aleatórias que contam, entre outras coisas, o número de ocorrências (às vezes chamadas de "chegadas") que ocorrem durante um determinado período de tempo.

Definição

Se o número médio de ocorrências em um intervalo de tempo fixo for λ , então a probabilidade de que haja exatamente k ocorrências ( k sendo um inteiro natural , k = 0, 1, 2 ... ) é ou :

- e é a base do exponencial ( e ≈ 2,718 ... );

- k ! é o fatorial de k ;

- λ é um número real estritamente positivo .

Dizemos então que X segue a lei de Poisson do parâmetro λ , denotada .

Por exemplo, se determinado tipo de evento ocorre em média 4 vezes por minuto , para estudar o número de eventos que ocorrem em um período de 10 minutos, escolhemos como modelo uma distribuição de Poisson com parâmetro λ = 10 × 4 = 40 .

Cálculo de p ( k )

Este cálculo pode ser feito dedutivamente trabalhando em uma distribuição binomial de parâmetros ( T ;λT) Para T grande, provamos que a lei binomial converge para a lei de Poisson.

Também pode ser feito indutivamente estudando no intervalo [0; T ] as funções F k ( t ) , que fornecem a probabilidade de que o evento ocorra k vezes no intervalo de tempo [0; t ] . Usando recorrência e cálculo diferencial, conseguimos encontrar as fórmulas anteriores.

Propriedades

Ao longo desta seção, X é uma variável aleatória seguindo uma lei de Poisson com parâmetro λ .

Momentos e funções geradoras

Momentos comunsOs primeiros quatro momentos ordinários de uma distribuição de Poisson são dados por:

Deduzimos a variação e o desvio padrão :

De modo mais geral, o n º tempo comum um parâmetro de Poisson λ éonde S ( n , k ) é o número de Stirling do segundo tipo de parâmetros e .

Em particular, quando o n- th momento de X corresponde ao n- th número de Bell . Na verdade, isso é uma consequência da fórmula de Dobiński .

O limite a seguir amplia os momentos de uma distribuição de Poisson:Temos a relação de recorrência:

Momentos centradosOs primeiros quatro momentos centrados de uma distribuição de Poisson são dados por:

Deduzimos a assimetria e a curtose normalizada :

Temos a relação de recorrência:

Momentos fatoriaisA r th momento fatorial de uma distribuição de Poisson é

onde denota o fatorial decrescente .

Função geradora de probabilidadeA função que gera as probabilidades de uma distribuição de Poisson é

Função geradora de momento

A função geradora dos momentos de uma distribuição de Poisson é

Demonstração

Seja X uma variável aleatória seguindo uma distribuição de Poisson com parâmetro λ . Lembre-se disso por definição .

Ter esperança

Variância

Função geradora

Lembramos que a função geradora de X é definida por . Então temos:

Função geradora de momento

Lembramos que a função geradora dos momentos de X é definida por . Então temos:

Momentos fatoriais

Momentos

Os números de Stirling do segundo tipo verificam a relação

.Assim, usando a fórmula dos momentos fatoriais de uma lei de Poisson, bem como a linearidade da expectativa, concluímos que

.Gráfico de barras

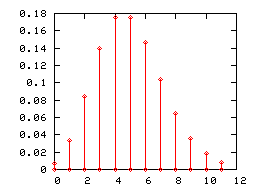

Como qualquer lei de probabilidade discreta , uma lei de Poisson pode ser representada por um gráfico de barras. Abaixo são mostrados os diagramas de barras das leis de Poisson dos parâmetros 1, 2 e 5.

Quando o parâmetro da lei de Poisson λ torna-se grande, (praticamente quando é maior que 5), seu diagrama de barras é corretamente aproximado pelo histograma de uma lei normal de expectativa e variância igual a λ (intervalo de classe l 'sendo igual à unidade). Essa convergência foi aproveitada, antes que os recursos do computador se tornassem generalizados, para usar a lei normal em vez da lei de Poisson em certos testes.

Estabilidade da distribuição de Poisson pela soma

Se as variáveis { X i } i = 1, ..., n são independentes e seguem uma lei de Poisson com os respectivos parâmetros λ i , então sua soma segue uma lei de Poisson com o parâmetro a soma de λ i :

DemonstraçãoMostramos o caso n = 2 , os casos superiores são deduzidos por indução.

Lembre-se disso Então temos

Independência foi usada em 2 e iguais. A última igualdade é obtida por meio da fórmula binomial de Newton .

Terminais de cauda

Um argumento do tipo limite de Chernoff permite deduzir os seguintes limites de cauda

para todo x > λ e para todos os x <λ .Esses terminais podem ser reescritos da seguinte forma

para todo x > 0 e para todo λ> x > 0onde para tudo . Estes últimos limites envolvem em particular o seguinte poste de amarração (que é mais fraco, mas mais agradável de manusear)

.O limite superior dado por Chernoff pode ser melhorado por um fator de pelo menos 2

para todo x > 0 .Deve-se notar que a função h está ligada à divergência de Kullback-Leibler entre uma lei de Poisson com parâmetro x + λ e uma lei de Poisson com parâmetro λ . Na verdade, temos a relação

.Simulação

Um algoritmo simples para simular a lei de Poisson é usar o seguinte resultado:

Teorema - Seja ( E i ) i ≥ 1 uma sequência de variáveis aleatórias independentes com a mesma distribuição exponencial do parâmetro λ . Definimos S 1 = E 1 e para n ≥ 2 , S n = E 1 + ... + E n . Então temos:

O método de transformação inversa fornece uma maneira simples de gerar um sorteio aleatório de acordo com uma lei exponencial:

Se U segue uma lei uniforme em [0; 1] , então E = -1λln ( U ) segue uma lei exponencial com parâmetro λ .O algoritmo pode, portanto, ser simplificado por:

- k ← 0 , p ← 1

- contanto que p > e –λ

- desenhamos u de acordo com um sorteio aleatório uniforme em [0; 1]

- p ← p × u

- k ← k +1

- nós retornamos k - 1

Estimativa do parâmetro λ

O estimador de máxima verossimilhança do parâmetro λ de uma amostra derivada de uma distribuição de Poisson é a média empírica . É um estimador convergir sem viés , eficaz , abrangente (in) , exaustivo .

Link com outras leis de probabilidade

- Se X e Y são duas variáveis aleatórias independentes que seguem as leis de Poisson dos respectivos parâmetros λ e μ , então X - Y é uma variável aleatória que segue uma lei de parâmetros de Skellam (λ, μ ) .

- Se X e Y são duas variáveis aleatórias independentes que seguem as leis de Poisson com parâmetros λ e μ , então a lei condicional de X sabendo X + Y é uma lei binomial .

- Para grandes valores de λ , podemos nos aproximar da lei de Poisson pela lei normal da média λ e da variância λ .

Link com a lei de Bernoulli

A contagem de eventos raros geralmente é feita através da soma de variáveis de Bernoulli , a raridade dos eventos resultando no fato de que os parâmetros dessas variáveis de Bernoulli são pequenos (portanto, a probabilidade de cada evento ocorrer é baixa). A ligação entre a lei de Poisson e eventos raros pode então ser declarada da seguinte forma:

Paradigma de Poisson - A soma S n de um grande número de variáveis independentes de Bernoulli de parâmetro pequeno segue aproximadamente a distribuição de Poisson do parâmetro

A desigualdade de Le Cam diz que o paradigma de Poisson é uma tabela de variáveis aleatórias Bernoulli independentes , com respectivos parâmetros p k , n . Nós notamos

Desigualdade de Le Cam - Para qualquer conjunto A de números naturais,

Em particular, se as duas condições a seguir forem atendidas:

então S n converge em lei para a distribuição de Poisson com o parâmetro Eficiência (estatística)

Na afirmação do paradigma de Poisson , fazemos duas suposições (vagas) sobre os termos de uma soma S n de variáveis de Bernoulli:

- os parâmetros das variáveis de Bernoulli são pequenos; no entanto, as duas condições acima significam que

que reformula a hipótese “ os parâmetros das variáveis de Bernoulli são pequenos ” com mais precisão;

- há um grande número de termos; no entanto, as duas condições acima levam ao número de termos tendendo ao infinito:

Notas:

- Esse paradigma permanece relevante, sob certas condições, se relaxarmos a hipótese de independência .

- Um exemplo notável é o número de pontos fixos de uma permutação desenhada aleatoriamente .

- Outro exemplo é o número de pontos isolados do grafo aleatório , cuja convergência para a lei de Poisson permitiu a Erdös e Rényi demonstrar, em 1960, o teorema exponencial duplo .

- O caso particular de um n = n , p k, n = λ / n , λ n = λ , da desigualdade de Le Cam, especifica a velocidade de convergência do direito binomial de parâmetros n e λ / N para a lei de Poisson com parâmetro λ .

Áreas de aplicação

O campo de aplicação da lei de Poisson foi por muito tempo limitado ao de eventos raros como suicídios de crianças, chegada de barcos a um porto ou acidentes por chute de cavalos em exércitos (estudo de Ladislaus Bortkiewicz ).

Mas nas últimas décadas seu campo de aplicação se ampliou consideravelmente. Atualmente, é amplamente utilizado em telecomunicações (para contar o número de comunicações em um determinado intervalo de tempo), controle estatístico de qualidade (número de defeitos no SPC ), a descrição de certos fenômenos relacionados à decadência radioativa (a decadência de núcleos radioativos seguindo, além disso, uma lei exponencial de parâmetro também observou lambda), biologia ( mutações no experimento de Luria e Delbrück , número de potenciais de ação emitidos por um neurônio em neurociências), meteorologia , finanças para modelar a probabilidade de um default de crédito, Yield Management ( American Airlines, Lufthansa e SAS para estimar a demanda de passageiros), etc.

Na literatura

No romance de Thomas Pynchon , The Rainbow of Gravity , um dos personagens, o estatístico Roger Mexico, usa a lei de Poisson para mapear as áreas de impacto dos foguetes V2 alemães na cidade de Londres durante a Segunda Guerra Mundial .

Notas e referências

- Com as convenções usuais 0! = 1 e 0 0 = 1 , a definição da lei de Poisson estende-se a λ = 0 : então encontramos p (0) = 1 e, assim que k > 0 , p ( k ) = 0 . Assim, uma variável aleatória quase certa de zero pode ser vista como seguindo a lei de Poisson do parâmetro 0. Essa convenção é consistente com as propriedades essenciais da lei de Poisson do parâmetro estritamente positivo. É conveniente, mesmo essencial, por exemplo, durante o estudo dos processos pontuais de Poisson.

- Siméon-Denis Poisson, Pesquisa sobre a probabilidade de julgamentos em matéria penal e civil; precedido pelas Regras Gerais para o Cálculo de Probabilidades em Gallica , 1837, passagem 81, p. 205.

- Ver, por exemplo, Michel Henry, Around Probability model , Presses Universitaires de Franche-Comté,2001( apresentação online ) , p. 229-231ou essas notas do curso .

- (em) Eric W. Weisstein, " distribuição de Poisson " em mathworld.wolfram.com

- (em) D Thomas Ahle, " Sharp and Simple Bounds for the raw moment of the Binomial and Poisson distributions " , arXiv ,2021( arXiv 2103.17027 , leia online )

- (en) Norman L Johnson, Adrienne W Kemp e Samuel Kotz, Univariate Discrete Distributions , Wiley,2005, 3 e ed. ( ISBN 978-0-471-27246-5 , leitura online ) , p. 162

- (em) Michael Mitzenmacher e Eli Upfal , Probability and Computing: Randomized Algorithms and Probabilistic Analysis , Cambridge, UK, Cambridge University Press,2005( ISBN 978-0-521-83540-4 , leitura online ) , p. 97

- (en) " Uma breve nota sobre os limites da cauda de Poisson "

- (em) Michael Short, " Improved Inequalities for the Poisson and Binomial Distribution and Quantile Functions Upper Tail " , International Scholarly Research Notices , vol. 2013,2013( DOI https://doi.org/10.1155/2013/412958 , leia online )

- (em) L. Le Cam , " Um Teorema de Aproximação para a Distribuição Binomial de Poisson " , Pacific Journal of Mathematics , vol. 10, n o 4,1960, p. 1181–1197 ( ler online , acessado em 13 de maio de 2009 ).

- (em) AD Barbour , L. Holst e S. Janson , aproximação de Poisson , Oxford, Clarendon Press, Oxford University Press,1992, 277 p. ( ISBN 0-19-852235-5 ).

- Ladislaus Bortkiewicz, Das Gesetz der kleinen Zahlen ,1898( leia online ), p. 23 .

![\ lambda \ in {}] 0, + \ infty [](https://wikimedia.org/api/rest_v1/media/math/render/svg/d64752215a3200cc640a035056f6d840f009fe0b)

![{\ displaystyle \ lambda [1 \! - \! \ log (\ lambda)] \! + \! \ mathrm {e} ^ {- \ lambda} \ sum _ {k = 0} ^ {\ infty} {\ frac {\ lambda ^ {k} \ log (k!)} {k!}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/260583c8721f140a26b2fedd0ca7be11779647cd)

![{\ displaystyle {\ begin {array} {lll} \ mathbb {E} [X] & = & \ lambda \\\ mathbb {E} [X ^ {2}] & = & \ lambda (1+ \ lambda) \\\ mathbb {E} [X ^ {3}] & = & \ lambda (1 + 3 \ lambda + \ lambda ^ {2}) \\\ mathbb {E} [X ^ {4}] & = & \ lambda (1 + 7 \ lambda +6 \ lambda ^ {2} + \ lambda ^ {3}) \ end {array}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4b5f229e400d5527be88286de93808928fee3fd0)

![{\ displaystyle \ mathbb {E} [X ^ {n}] \ leq {\ frac {k ^ {k}} {\ ln \ left ({\ frac {k} {\ lambda}} + 1 \ right)} } \ leq \ lambda ^ {k} e ^ {\ frac {k} {2 \ lambda}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6f26f129702b3bd3e0c74db7007cd6598d8d8cf4)

![{\ displaystyle \ mathbb {E} [X ^ {n}] = \ lambda \ mathbb {E} [X ^ {n-1}] + \ lambda {\ frac {\ partial \ mathbb {E} [X ^ { n-1}]} {\ partial \ lambda}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ca9be13f332e8e03361fd2d757d4e7418692915d)

![{\ displaystyle {\ begin {array} {lll} \ mathbb {E} [(X- \ lambda) ^ {2}] & = & \ lambda \\\ mathbb {E} [(X- \ lambda) ^ { 3}] & = & \ lambda \\\ mathbb {E} [(X- \ lambda) ^ {4}] & = & \ lambda (1 + 3 \ lambda) \\\ mathbb {E} [(X- \ lambda) ^ {5}] & = & \ lambda (1 + 10 \ lambda) \ end {array}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ca8e9b593d346b6915a7b04e1d6b473eea1b6c7b)

![{\ displaystyle \ mathbb {E} [(X- \ lambda) ^ {n + 1}] = n \ lambda \ mathbb {E} [(X- \ lambda) ^ {n-1}] + \ lambda {\ frac {\ partial \ mathbb {E} [(X- \ lambda) ^ {n}]} {\ partial \ lambda}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/955a8a1c478f4348faa633d0b0bc3ce5781744c4)

![{\ displaystyle {\ begin {alinhados} V (X) & = \ mathbb {E} (X ^ {2}) - (\ mathbb {E} (X)) ^ {2} & \\ & = \ sum _ {k = 1} ^ {\ infty} k ^ {2} \, \ mathbb {P} (X = k) - \ lambda ^ {2} & \\ & = \ sum _ {k = 1} ^ {\ infty} k ^ {2} \, \ mathrm {e} ^ {- \ lambda} {\ frac {\ lambda ^ {k}} {k!}} - \ lambda ^ {2} & \\ & = \ lambda \, \ mathrm {e} ^ {- \ lambda} \ sum _ {k = 1} ^ {\ infty} \, {\ frac {k \ lambda ^ {k-1}} {(k-1)!} } - \ lambda ^ {2} & \\ & = \ lambda \, \ mathrm {e} ^ {- \ lambda} \ sum _ {k = 1} ^ {\ infty} \, {\ frac {d} { d \ lambda}} {\ frac {\ lambda ^ {k}} {(k-1)!}} - \ lambda ^ {2} & \ qquad ({\ text {toda a série tendo um raio de convergência infinito,} } \\ & = \ lambda \, \ mathrm {e} ^ {- \ lambda} {\ frac {d} {d \ lambda}} \ sum _ {k = 1} ^ {\ infty} \, {\ frac {\ lambda ^ {k}} {(k-1)!}} - \ lambda ^ {2} & \ qquad {\ text {podemos reverter a soma e a derivação}}) \\ & = \ lambda \, \ mathrm {e} ^ {- \ lambda} {\ frac {d} {d \ lambda}} \ left [\ lambda \ sum _ {k = 1} ^ {\ infty} \, {\ frac {\ lambda ^ {k-1}} {(k-1)!}} \ right] - \ lambda ^ {2} & \ qquad ({\ text {reconhecemos a expansão serial inteira de}} \ mathrm {e} ^ {\ lambda}) \\ & = \ lambda \, \ mathrm {e} ^ {- \ lambda} {\ frac {d} {d \ lambda}} [\ lambda \, \ mathrm {e} ^ {\ lambda}] - \ lambda ^ {2} & \\ & = \ lambda \, \ mathrm {e} ^ {- \ lambda} (\ lambda +1) \, \ mathrm {e} ^ {\ lambda} - \ lambda ^ {2} & \\ & = \ lambda \, (\ lambda +1 ) - \ lambda ^ {2} & \\ & = \ lambda. & \ end {alinhado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7b8c275017a53b44357fe83f517049c0073b4052)

![{\ displaystyle \ mathbb {E} [S_ {n}]. \}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4169e81cf9921bebbec6592d094a01e875df7b5a)

![S_n = \ sum_ {k = 1} ^ {a_n} \, X_ {k, n} \ quad \ text {e} \ quad \ lambda_n \ = \ \ mathbb {E} [S_n] = \ sum_ {k = 1 } ^ {a_n} \, p_ {k, n}. \](https://wikimedia.org/api/rest_v1/media/math/render/svg/fa48961dc784a0fd1d047e71159fdd008492bea8)